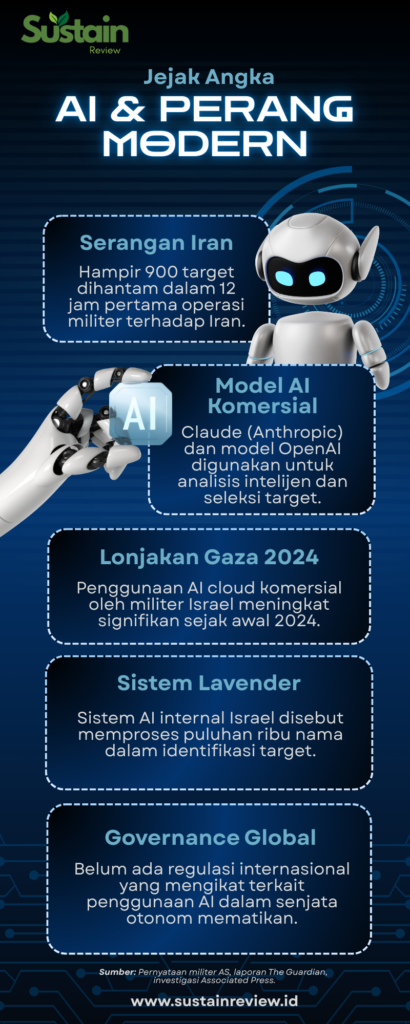

SERANGAN hampir 900 target dalam 12 jam ke Iran bukan hanya peristiwa militer. Itu adalah sinyal perubahan arsitektur perang modern.

Militer Amerika Serikat mengakui penggunaan sistem kecerdasan buatan (AI), termasuk model Claude dari Anthropic, untuk menganalisis data intelijen dalam skala besar sebelum penentuan target. Sistem analitik yang terintegrasi dengan platform seperti Palantir mempercepat proses seleksi sasaran, simulasi dampak, hingga evaluasi dasar hukum serangan.

Perubahan ini menandai fase baru. AI masuk ke dalam rantai keputusan militer.

Dari Analisis Data ke Kompresi Keputusan

Secara teknis, AI tidak menggantikan komando manusia. Namun, AI mempercepat seluruh siklus observasi, orientasi, keputusan, aksi (OODA loop). Akademisi menyebut fenomena ini sebagai decision compression.

Craig Jones, dosen senior geografi politik Universitas Newcastle, menyatakan kepada The Guardian bahwa mesin AI kini mampu memberikan rekomendasi target “lebih cepat daripada kecepatan berpikir manusia”.

Baca juga: Ekonomi AI dan Ujian Strategi Data Nasional Indonesia

Kecepatan ini mengubah struktur risiko.

Operasi yang sebelumnya membutuhkan waktu berhari-hari kini dapat dilaksanakan hampir simultan. Dalam konteks eskalasi geopolitik, percepatan ini mempersempit ruang diplomasi dan de-eskalasi.

Kompresi keputusan berpotensi menciptakan spiral konflik yang bergerak lebih cepat daripada mekanisme politik untuk meredamnya.

Governance Gap dalam AI Militer

Sebagian perusahaan teknologi menyatakan produk mereka tidak ditujukan untuk penggunaan ofensif. Namun, praktik di lapangan menunjukkan model AI komersial telah terintegrasi dalam sistem militer.

Investigasi Associated Press pada 2025 mengungkap penggunaan model OpenAI melalui platform Azure Microsoft oleh militer Israel selama operasi di Gaza. Laporan The Guardian sebelumnya juga menyebut sistem penargetan berbasis AI seperti “Lavender” berperan dalam identifikasi ribuan target.

Baca juga: Ekonomi AI Menguat, Arsitektur SDM Nasional Dipertaruhkan

Pertanyaannya bukan lagi apakah AI digunakan.

Melainkan, siapa yang mengatur, mengaudit, dan mempertanggungjawabkan penggunaannya?

Hingga kini belum ada kerangka global yang mengikat terkait penggunaan AI dalam sistem senjata mematikan. Diskusi di PBB mengenai Lethal Autonomous Weapons Systems (LAWS) masih berjalan tanpa konsensus final.

Kesenjangan tata kelola ini menciptakan risiko sistemik. Algoritma bekerja lintas negara, tetapi regulasi tetap domestik dan terfragmentasi.

Risiko Eskalasi dan Kesalahan Sistemik

AI meningkatkan efisiensi, tetapi juga memperbesar skala dampak kesalahan.

Model transkripsi dan analisis bahasa, misalnya, diakui pengembangnya dapat menghasilkan interpretasi keliru atau bias. Dalam konteks sipil, kesalahan berarti koreksi data. Dalam konteks militer, kesalahan berarti korban.

Beberapa laporan yang dikutip The Guardian menyebut adanya pertimbangan kuantitatif terhadap estimasi korban sipil sebelum serangan disetujui. Hal ini menunjukkan pergeseran dari penilaian kualitatif berbasis komandan lapangan ke pendekatan berbasis probabilitas statistik.

Efisiensi tidak selalu identik dengan legitimasi.

Relevansi bagi Indonesia

Hingga saat ini, belum terdapat kerangka regulasi publik yang secara spesifik mengatur penggunaan kecerdasan buatan (AI) dalam sistem pertahanan nasional. Strategi Nasional AI 2020–2045 lebih berfokus pada sektor sipil seperti kesehatan, pendidikan, reformasi birokrasi, dan pengembangan smart city.

Dalam domain pertahanan, belum tersedia referensi kebijakan terbuka yang menjelaskan bagaimana integrasi AI dalam sistem komando, pengawasan, atau pengambilan keputusan militer ditempatkan dalam kerangka tata kelola nasional.

Baca juga: Menteri Virtual Albania dan Masa Depan ESG Governance di Sektor Publik

Sebagai negara dengan posisi strategis di Indo-Pasifik, Indonesia berpotensi terdampak oleh percepatan eskalasi regional berbasis AI, terutama jika dinamika keamanan bergerak lebih cepat dari mekanisme diplomasi.

Sejumlah pertanyaan kebijakan yang relevan untuk diskursus publik antara lain:

- Apakah Indonesia memerlukan kerangka audit dan akuntabilitas untuk sistem AI di sektor pertahanan?

- Bagaimana prinsip hukum humaniter internasional diterjemahkan dalam sistem berbasis algoritma?

- Apakah ASEAN perlu mengembangkan norma bersama terkait tata kelola AI militer?

Tanpa kerangka tata kelola yang eksplisit, negara berkembang berisiko menjadi pengguna teknologi tanpa posisi normatif yang kuat dalam pembentukan standar global.

Menuju Tata Kelola AI Pertahanan

AI telah masuk dalam arsitektur keputusan militer global. Transformasi ini tidak bisa diputar kembali. Namun, percepatan teknologi tidak selalu diikuti percepatan regulasi.

Jika kompresi keputusan terus berlangsung tanpa kerangka tata kelola yang jelas, stabilitas global dapat terdampak oleh konflik yang bergerak lebih cepat dari kapasitas diplomasi.

Bagi Indonesia, momentum ini menjadi ujian kebijakan. Apakah akan menjadi pengguna pasif teknologi pertahanan berbasis AI, atau ikut membentuk norma regional dan global tentang bagaimana algoritma boleh dan tidak boleh digunakan dalam perang. ***

- Foto: Ilustrasi/ Fernando Narvaez/ Pexels – Pusat kendali dengan dashboard analitik digital yang menggambarkan integrasi kecerdasan buatan (AI) dalam sistem pemantauan dan pengambilan keputusan strategis.